La race et le genre à l’épreuve du code

Mercredi 13 juin / 19-21h

Conférences de Peggy Pierrot

Performance de Mimi Onuhoa

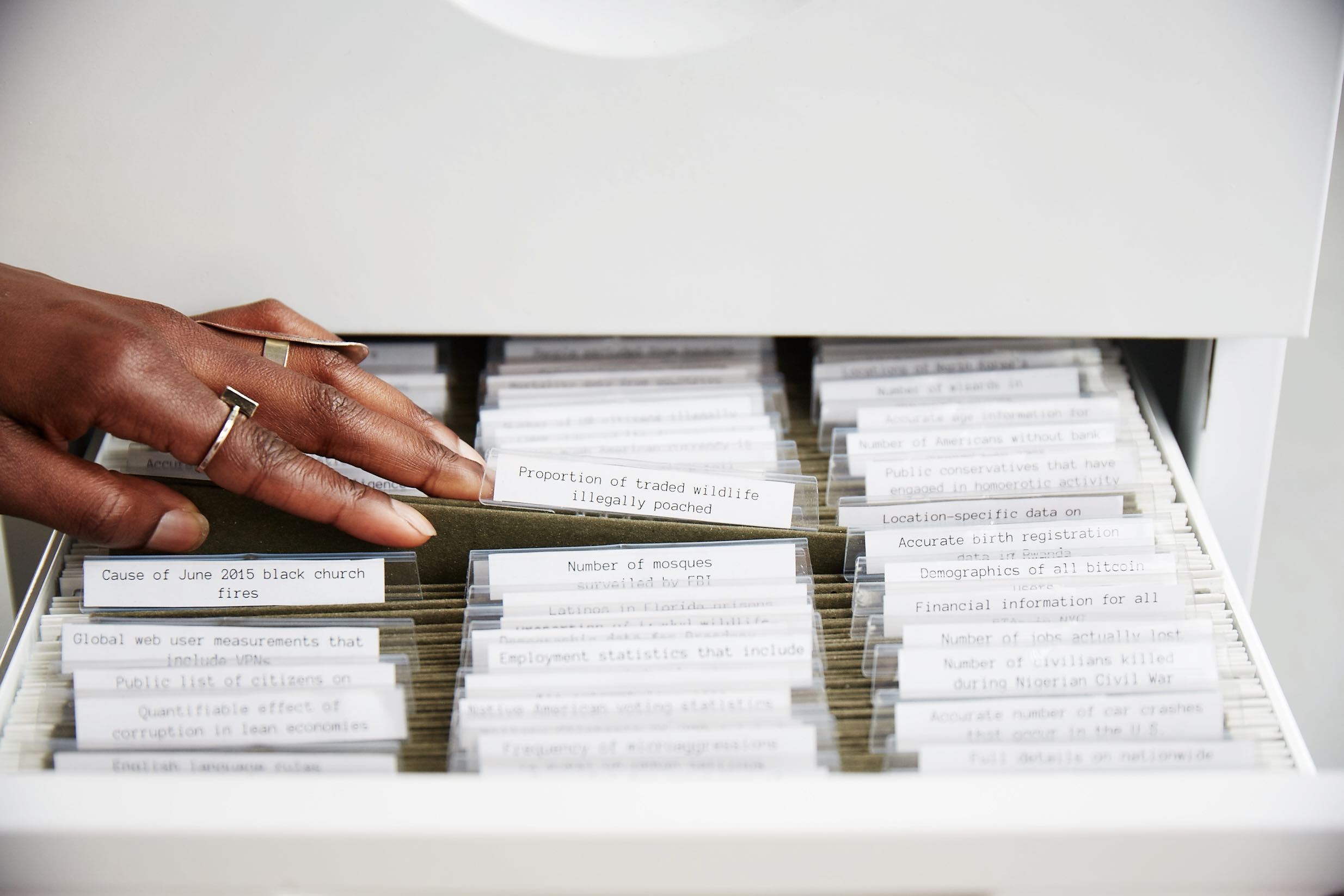

The Library of Missing Datasets, Mimi Onuoha.

Cette séance aborde les biais du code. La mythologie qui a longtemps consisté à présenter les technologies de l’information et de la communication comme neutres, abolissant les différences de race, de genre et les frontières est depuis le début des années 2000 fortement mise à mal par des travaux de chercheur.ses - des sciences dures aux humanités en passant par des artistes et des développeurs - qui mettent en évidence les biais de genre et les biais raciaux du code.

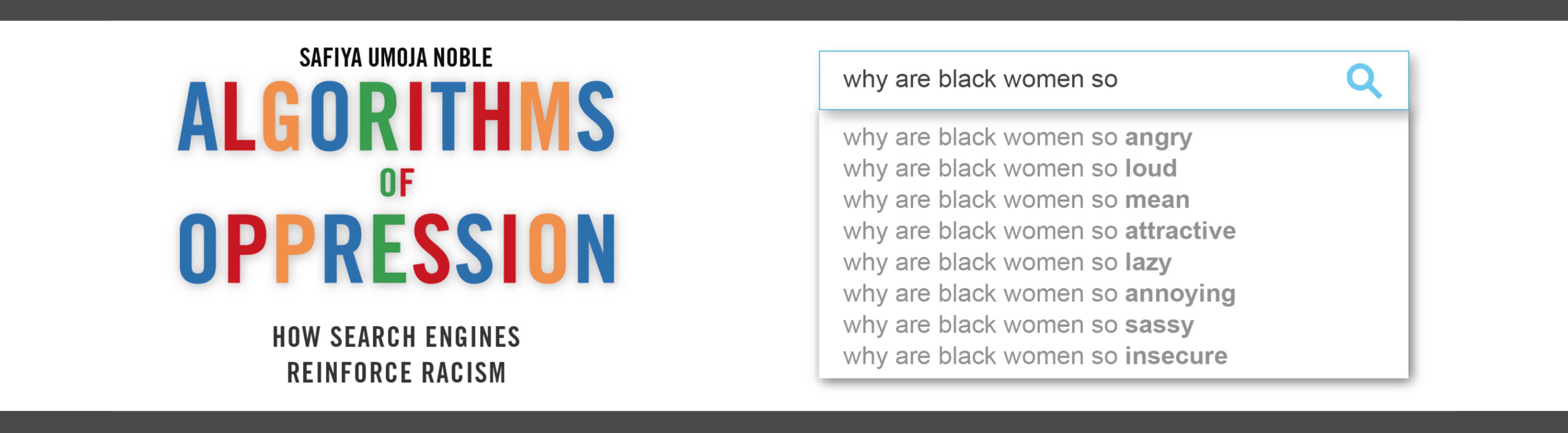

Dans son étude Algorithms of oppression qui questionne le pouvoir des algorithmes à l’ère néolibérale, la sociologue africaine-américaine Safiya Umoja Noble démontre comment les moteurs de recherche renforcent les relations sociales oppressives et instituent de nouveaux modes de profilage racial.

Entre absence de prise en compte et instrumentalisation de la couleur de peau, les algorithmes ne sont pas color blind (indifférents à la couleur de peau). Joy Buolamwini, aka la Poétesse du code, chercheuse en intelligence artificielle au MIT est récemment partie en croisade pour inciter les personnes de couleur à investir les études en mathématiques et ingénierie après avoir constaté que les logiciels de reconnaissance faciale dont elle avait besoin pour ses travaux en robotique ne reconnaissait pas sa couleur de peau et pour cause, ils étaient essentiellement conçus et testés par des personnes blanches.

Une enquête menée aux Etats-Unis de 2010-2011 sur les diplômes en informatique a révélé que sur les 1 456 titulaires d'un doctorat décernés au cours de la période, 16 (1,2%) ont été attribués à des Noirs. En 2013, parmi les 1 563 titulaires d'un doctorat en sciences informatiques, 19 étaient des Noirs.

Conférence

Peggy Pierrot

Peggy Pierrot est une webmaster, chercheure, journaliste et activiste vivant à Bruxelles. Elle est actuellement responsable pédagogique et tutrice des Ateliers des Horizons (ex-école du Magasin, Grenoble). Elle travaille principalement à Bruxelles avec différentes associations et structures pédagogiques ou de recherche. Ses outils favoris sont les sciences humaines et les logiciels libres. Elle donne des conférences et ateliers sur les cultures et littératures afro-atlantiques, la science-fiction, la création radiophonique, les médias et technologies. Elle est titulaire d’un master en sociologie et d’un master professionnel en information-communication.

Dans Modifier l'universel, elle analyse avec Roel Roscam Abbing et Femke Snelting les enjeux qui sous-tendent la décision de l’Unicode Consortium d’ajouter cinq modificateurs de couleurs de peau aux spécifications du noyau de l’Unicode 9.0, une norme qui code plus de mille caractères emoji. Cette décision a été prise en 2015 en réponse aux protestations croissantes contre le manque de diversité ethnique visible dans les caractères Emoji disponibles sur les smartphones.

Conférence et proposition artistique

Mimi Onuoha

Mimi Onuoha, artiste et chercheuse, de parents Nigérians vivant aux États-Unis, interroge les conséquences de la collecte de données et de la catégorisation informatique. Elle utilise le code, l’écriture et les objets pour explorer les données manquantes et les façons dont les individus sont généralisés, représentés et classifiés. Elle s’attache à mettre en évidence que la collecte, l’enregistrement et l’archivage des données sont liés aux questions de contrôle et de pouvoir, elle défend également l’idée qu’il existe des situations dans lesquelles il peut être avantageux pour un groupe de rester en dehors des limites de la collecte de données pour se protéger.

Gaîté Lyrique

Auditorium

3 bis rue Papin

75003 Paris

Tarif : 6 euros

(pass 6 séances : 30 euros)

dans le sillage d’Octavia E. Butler

La paraboles des talents

A propos de la série des Paraboles d’Octavia E. Butler, entamée en 1989, la journaliste américaine Abby Aguirre écrit :

Butler a extrapolé sa vision d'une dystopie dans un futur proche à partir de ce qu'elle lisait dans l'actualité, prédisant le genre d'effondrement qui pourrait advenir si les forces du capitalisme tardif, le changement climatique, l'incarcération de masse, la Big Pharma, la violence armée et l'industrie de la tech se poursuivait sans entrave. […] Butler portait un regard cyclique sur l'histoire. Elle pensait aussi que le progrès social était réversible. Tandis que la sphère publique se vidait progressivement de sa substance, la peur du changement allait créer une brèche pour des politiques rétrogrades. Avec l'effondrement, le racisme deviendrait plus manifeste.

La parabole des talents, publiée en 1998, débute en 2032. Á cette date, différentes formes de travail forcé et d'esclavage sont monnaie courante, facilitées par des colliers d'esclaves high-tech. L'oppression des femmes est devenue extrême ; celles qui expriment leurs opinions, “ les râleuses ”, risquent d'avoir la langue coupée. Les gens ont développé des addictions non seulement pour des drogues de synthèse mais aussi pour des “ masques à rêves ” qui génèrent des fantasmes virtuels, permettant à ceux qui les portent de s'immerger dans des vies plus simples, plus belles.

Abby Aguirre, « Octavia Butler’s Prescient Vision of a Zealot Elected to “Make America Great Again” », The New Yorker, 26 juillet 2017 (source)

ressources

Alondra Nelson, Venus Green, Anna Everett, Safiya Umoja Noble... Sur la place des Noir.e.s dans l’histoire de l’informatique à la mise en évidence des biais du code.

1. « La « race » serait-elle le funeste fantôme dans la machine ? »

Dirigé par Franck Freitas, doctorant en science politique et Maxime Cervulle, maître de conférences en sciences de l’information et de la communication à l’Université Paris 8, le numéro 10 de la revue Poli paru en 2015 se penche sur les « techno-racismes ». Derrière ce néologisme composé, il s’agit de mettre à jour « les présupposés raciaux qui se trouvent inscrits dans les objets, appareils et dispositifs techniques, ainsi que dans leurs usages ; présupposés qui 1) privilégient de manière active, bien qu’implicite, les utilisateurs blancs ; 2) renforcent et légitiment l’exclusion ou l’exploitation de groupes minorisés ; 3) reproduisent et matérialisent l’idée de « race » ; 4) sont le support de normes raciales. » Ainsi peut-on qualifier de techno-racistes : les technologies et les usages des technologies orientés à des fins d’esclavages, de colonisation et d’extermination; les pratiques d’entreprises telles que la compagnie de téléphonie Bell par exemple, dont l’organisation technique du travail va s’inscrire dans une division racialisée et sexuée du travail des opératrices (voir Race on the Line, ci-après) ; l’occultation des contributions d’acteurs sociaux noirs aux innovations techniques ou encore les tentatives récentes de classification des populations humaines par la génétique ou l’imagerie neuronale. Le texte inaugural est un passage du livre du chercheur britannique Richard Dyer, White. En se focalisant sur l’éclairage cinématographique, le chercheur interroge les usages technologiques et plus largement, la « culture de la lumière » qui a privilégié le visage blanc tout en construisant la représentation des Noirs en problème technique.

Le numéro se clôt sur un entretien de Franck Freitas avec Alondra Nelson, sociologue africaine-américaine dont les travaux portent sur les intersections entre science, médecine et inégalités. Pour la sociologue qui a co-dirigé le célèbre numéro de Social Text sur l’Afrofuturism en 2002, l’expérience noire est inextricablement liée aux technologies de communication, et Internet en particulier. La dissémination des populations noires qui a suivi l’esclavage et la colonisation a « posé les jalons de l’ère des réseaux et des communautés dispersées ». Le monde numérique peut aussi être interprété par le concept de double conscience développé par W. E. B. Dubois qui « permet de penser les dimensions ambivalentes de l’identité et de développer les possibilités d’une conscience diasporique ». C’est placées dans cette perspective que les technologies numériques peuvent servir à la mobilisation collective afin de combattre les problèmes qui affectent précisément les populations noires. Son dernier ouvrage The Social Life of DNA : Race, Reparations and Reconciliation after the Genome porte sur la dimension raciale de la recherche sur le génome.

Lien vers le Poli N°10, Techno-racismes

2. Algorithmes de l’oppression, comment les moteurs de recherche renforcent le racisme

Dans son livre Algorithms of oppression, How Search Engines Reinforce Racism, la chercheuse Safiya Umoja Noble démontre comment des biais négatifs envers les femmes de couleur sont encodées dans les résultats des moteurs de recherche et dans les algorithmes. La requête “black girls” dans le moteur de recherche de Google, le plus largement utilisé, propose dans les premiers résultats “Big Booty” et d’autres termes sexuellement explicites. Parmi les suggestions arrivent en tête les sites pornographiques ou des discussions non-modérées sur les questions « pourquoi les femmes noires sont-elles si impertinentes » ou « pourquoi les femmes noires sont-elles si colériques? », présentant un portrait troublant de la feminité noire dans la société contemporaine. Dans Algorithms of Oppression, Safya Umoja Noble remet en cause l’idée selon laquelle les moteurs de recherche comme Google offre un terrain de jeu égal à toutes les formes d’idées, d’identités et d’activités. La discrimination par les données est un problème social d’importance. Noble démontre que la combinaison d’intérêts privés dans la promotion de certains sites, et la position de monopole d’un nombre relativement restreint de moteurs de recherche sur Internet mène à un ensemble d’algorithmes de recherche biaisés qui favorise la blanchité et discrimine les gens de couleur et tout particulièrement les femmes. Les moteurs de recherche ne sont pas démocratiques pour les femmes et filles noires. Le récit de la neutralité et de l’objectivité dissuade ceux qui ont des protestations légitimes d’argumenter de manière efficace sur la mauvaise représentation. L’hypersexualisation et l’hyper visibilité des « blacks girls » comme objets sexuels empêchent toutes autres possibilités de représentations autres. L’idéologie du « color-blindness » obscurcit l’oppression structurelle et sociale dans des champs comme les sciences de l’informatique et de l’information qui façonnent les pratiques technologiques. Safiya Umoja Noble démontre au contraire que les inégalités structurelles de la société sont reproduites par l’Internet et que la quête cyberespace sans race, sans classe ne peut que perpétuer et renforcer les systèmes actuels de domination.

- Lien vers le livre

- Lien vers le site de Safiya U. Noble

- Lien vers l’article Google Search Hyper visibility as a means of rendering Black Women and girls invisible (InVisible Culture : An electronic journal for visual culture, issue 19, 29 octobre 2013)

- Lire aussiA future for intersectional black feminist technology studies, Safiya Umoja Noble

- Lien vers sa conference TEDx.

- Lien vers le site Algorithmic Justice League

- Lien vers le site Genderchanges.org

- Lienvers le site de Data4blacklives.

- Lien vers les vidéos des conférences l’événement.

- Lire aussi sur le même sujet l’article « Data Violence and How Bad Engineering Choices Can Damage Society »de Anna Lauren Hoffmann.

- Lien vers le livre Black Lives Matter. Le renouveau de la révolte noire américaine, de Keeanga-Yamahtaa Taylor, Agone 2017.

- Lien vers l’article Artist Sondra Perry uses avatars and animation to challenge representations of blackness (It is nice that Laura Snoad, 12 mars 2018)

- Lien vers l’article de Heather Dewey-Hagborg, Sci-fi Crime Drama with a Strong Black Lead (The New Inquiry).

- Lire aussi : “This Is a Story About Nerds and Cops”: PredPol and Algorithmic Policing de Jackie Wang (e-flux, journal #87, décembre 2017.

3. Pour une «Algorithmic Justice League »

Joy Buolamwini, doctorante au MIT, travaillait avec des logiciels de reconnaissance faciale quand elle a remarqué un problème : le logiciel ne reconnaissait pas son visage -- parce que ceux qui avaient codé l'algorithme ne lui avait pas appris à identifier toutes les couleurs de peau. Elle s'est donné pour mission de combattre le biais algorithmique dans le machine learning, un phénomène qu'elle nomme le « regard codé ». Dans une conférence TEDx, elle prône l'importance de la notion de responsabilité et la nécéssité d’intégrer les personnes de couleur dans le monde de la recherche en sciences et mathématiques.

Joy Buolamwini a créé l’Algorithmic Justice League pour lutter contre les biais algorithmiques qui peuvent avoir pour résultat des pratiques discriminatoires et des expériences d’exclusion.

Elle mène également le projet de recherche Gendershades.org, qui a évalué trois systèmes commerciaux de classification de genre montrant que les femmes à la peau sombre sont le groupe les plus mal reconnus par les algorithmes, avec des taux d’erreur allant jusqu’à 34,7%, alors que l’erreur maximale pour les hommes à la peau claire est de 0,8%. « Nous risquons de perdre les avantages obtenus avec le mouvement des droits civils et les mouvements des femmes en croyant à tort à la neutralité des machines. Les systèmes automatisés ne sont pas neutres intrinsèquement. Ils reflètent les priorités, les préférences et les préjudices – le regard codé – de ceux qui ont le pouvoir de modeler l’intelligence artificielle. » Les logiciels de reconnaissance faciale sont le plus souvent utilisés sur ces mêmes personnes qu’ils risquent d’identifier le plus mal. Autrement dit, les personnes noires.

4. Data for Black Lives : « Aujourd’hui la discrimination est une entreprise high-tech. »

Data for Black Lives est un groupe d’activistes, d’organisateurs et de mathématiciens qui s’est donné pour mission d’utiliser la science des données pour créer des changements effectifs dans la vie des personnes noires. La gestion des données sont potentiellement de puissants outils d’empowerment. Néanmoins, ces données sont trop souvent utilisées comme un instrument d’oppression, renforçant les inégalités et perpétuant les injustices. Parmi les préjudices, ils citent l’exclusion systématique des communautés noires de services financiers importants et des exemples plus récents comme la police prédictive, les condamnations fondées sur le risque potentiel et des pratiques de prêts abusifs.

5. Black Lives Matter. Le renouveau de la révolte noire américaine

« Le meurtre de Mike Brown par un policier blanc a marqué un point de rupture pour les Afro-Américains de Ferguson (Missouri). Peut-être était-ce à cause de l’inhumanité de la police, qui a laissé le corps de Brown pourrir dans la chaleur estivale. Peut-être était-ce à cause de l’arsenal militaire qu’elle a sorti dès les premières manifestations. Avec ses armes à feu et ses blindés, la police a déclaré la guerre aux habitants noirs de Ferguson. »

Comment le mouvement Black Lives Matter a-t-il pu naître sous le mandat du premier président noir ? L’auteure revient sur l’« économie politique du racisme » depuis la fin de l’esclavage, le reflux des mouvements sociaux des années 1960 et l’essor d’une élite noire prompte à relayer les préjugés racistes et anti-pauvres. Elle défend le potentiel universaliste de BLM : afro-américain et tourné contre les violences policières, il peut parfaitement rallier d’autres groupes et s’étendre à une lutte générale pour la redistribution des richesses. — 4e de couverture de la version en français.

Keeanga-Yamahtaa Taylor consacre le chapitre 2 à la période qui va suivre les mouvements de luttes pour les Droits civiques pendant laquelle va émerger le concept d’indifférence à la race, colorblindness. Le mouvement des Droits civiques a mis à mal l’idée selon laquelle les Noirs étaient pauvres du fait de leur paresse ou d’un déficit mental. Il a également servi de catalyseur à d’autres mobilisations contre d’autres oppressions telles que la guerre, les luttes féministes, les minorités sexuelles. Á la fin des années 1960, ces mouvements mettent en péril les fondements du capitalisme et l’image des Étas-Unis. De plus la reconnaissance de la légitimité des revendications sociales demanderait d’énormes investissements dans les infrastructures alors même que le boom économique des années d’après-guerre s’essouffle. Lancée au lendemain du mouvement pour les Droits civiques, par les milieux d’affaires, la contre-offensive va consister en une restauration idéologique et politique visant à réhabiliter l’ensemble du système capitaliste. Dans ce cadre, toutes les références aux discriminations raciales vont disparaître, inaugurant une nouvelle ère post-raciale dans laquelle tous les obstacles à la réussite des Noir.e.s sont prétendument levés. L’État fédéral va s’appuyer sur cette nouvelle image démocratique et le renouveau du mythe de méritocratie pour démanteler tous les programmes sociaux et des pans entier du service public sans qu’il soit désormais possible d’invoquer des discriminations raciales. La réussite d’une minorité d’Africains-Américains est censée démontrer que la Nation est désormais indifférente à la race et a rompu avec son passé raciste.

6. Regards d’artistes

Graft and Ash for a Three Monitor Workstation (2016) from Sondra Perry.

Sondra Perry

Artiste originaire du New Jersey, Sondra Perry utilise des outils numériques pour questionner les différentes manières dont la blackness a été présentée à travers l’histoire. Son travail vidéo habite la vallée de l’étrange où les images du web, les vidéos trouvées sur youtube et des avatars 3D comme matériau brut pour interroger la brutalité policière, explorer différentes facettes du féminisme et disséquer un pouvoir oppressif. Sa première exposition personnelle en Europe, à la Serpentine Gallery a rassemblé quatre œuvres explorant la manière dont la technologie peut façonner ou limiter la représentation, des systèmes de surveillance policière aux logiciels de construction d’avatars pour les jeux vidéos.

« Quand vous pensez à la technologie, tout particulièrement celle liée à la surveillance, vous pensez à des scans de rétine et à la collection de données, mais un dispositif technologique de vision peut être un tas de choses, dit Sondra Perry « Ca peut être l’œil d’un officier de police, ou un type de satellite ou d’imagerie. La technologie est depuis longtemps utilisée comme un outil d’oppression, visant spécifiquement les personnes de couleur. Les « Lantern laws aux Etats-Unis, par exemple obligeaient les esclaves à porter des lanternes avec eux tout le temps afin qu’ils soient visibles. « Mais ce que fait la Blackness, littéralement devenir sombre, peut vous aider à échapper à ces espaces », ajoute-t-elle. « Je considère aussi la blackness comme technologique, d’une certaine manière. » Dans plusieurs de ses installations, Sondra Perry met en scène son propre avatar 3D. Le processus consistant à créer son avatar était une manière de réclamer des espaces traditionnellement blancs et masculins. « Le logiciel avec lequel vous créez ces avatars ne montrent pas seulement quels sont les biais mais aussi quelles sont les croyances des programmeurs, explique-t-elle. « Par exemple, il n’existe pas d’option pour un corps gros et il y a tous ces gabarits pour certains phénotypes, les phénotypes asiatiques, africains, caucasiens, etc… Le logiciel vous permet de modifier tous les paramètres nécessaires pour réaliser un avatar réaliste, par conséquent est-il vraiment nécessaire d’avoir le phénotype d’un Africain qui a une certaine type de silhouette et un certain type de nez.

Heather Dewey Hagborg

L’artiste américaine Heather Dewey Hagborg crée depuis plusieurs années des portraits en impression 3D à partir d’ADN. Elle récupère des cheveux et des mégots dans l’espace public dont elle en extrait l’ADN pour intégrer ces données (genre, couleur des yeux, origine, poids) à un logiciel.

Ces nouvelles pratiques appelées Forensic DNA Phenotyping (FDP) créant des portraits robots à partir d’échantillons ADN retrouvés sur des scènes de crime sont désormais utilisées par la police. Le FDP n’est que la dernière version d’une longue succession de technologies qui prétendent utiliser la science pour classifier des types de corps dans des catégories comme le genre et la race qui sont des constructions sociales, observe l’artiste. « Plutôt que de rendre les procédures policières plus justes, le Forensic DNA phenotyping menace de saper des décennies de protestations, d’éducation et d’action politique cherchant à mettre fin au profilage racial, au racisme institutionnel et à la discrimination ».

7. Invisibilisation des personnes de couleur dans l’histoire de l’informatique

Dans Race on the Line: Gender, Labor, and Technology in the Bell System, 1880–1980, Venus Green, sociologue du travail, montre les convergences entre « race », genre et technologie qui vont prévaloir dans l’organisation du travail de l’entreprise de téléphonie américaine Bell. Sa recherche couvre la période qui va de l’invention du téléphone en 1876 à la dissolution de l’American Telephone and Telegraph Company en 1984. La sociologue qui a elle-même travaillé dans l’entreprise, montre comment le management va instrumentaliser les stéréotypes de genre et raciaux et comment les mutations technologiques du secteur vont avoir un impact direct sur la place et le travail des femmes — blanches et ensuite des femmes noires — dans l’entreprise. Le recrutement massif d’opératrices noires va coïncider avec le moment où l’entreprise se numérise et que toutes les responsabilités vont passer de l’opératrice téléphonique à l’ordinateur et à l’utilisateur. Enfin intégrées, les Africaines-s vont cependant occuper les postes les plus au bas de l’échelle des compétences, remplaçant les opératrices blanches qui, pour certaines d’entre elles, vont intégrer les fonctions de management.

+ L’article : Race and Technology: African American Women in the Bell System, 1945-1980, Venus Green, Technology and Culture, Vol. 36, No. 2, 1995.

Race & Computing: the Problem of Sources, the Potential of Prosopography, and the Lesson of Ebony Magazine, R. Arvid Nelsen

L’auteur de l’article constate que depuis quelques années, les historiens reconnaissent la nécessité d’étudier les liens entre race et technologie mais que les publications ne suivent pas, surtout si on fait la comparaison avec les études réalisées sur la question du genre. Ceci est encore plus aigu si l’on se penche sur la question de l’histoire de l’informatique. Ce déficit est essentiellement attribué à l’absence de sources. Du coup, la question de la « race » est étudiée de façon générale plutôt que de se pencher sur les personnes de couleurs qui ont contribué à l’histoire de l’informatique. Une histoire qui jusqu’à présent est largement dominée par les figures d’hommes blancs. Et pourtant, plaide R. Arvid Nelson, il serait essentiel de le faire car sans prendre en compte ces contributions, il est impossible de faire une histoire de l‘informatique précise. De plus, ils.elles, méritent d’être reconnu.e.s. Et enfin, cela permettrait de combattre l’idée relativement répandue que les Noirs n’ont pas développé de compétences ou d’intérêt pour l’informatique. Et c’est là que les sources non académiques se révèlent particulièrement pertinentes et devraient être plus prises en compte par les chercheurs. Ainsi le Magazine Ebony a répertorié pas moins de 57 Africains-Américains travaillant dans le domaine de l’informatique entre 1959 et 1996. Si l’informatique a peu à dire sur les personnes de couleur, il est peut-être plus intéressant de voir ce que les communautés ont à dire sur l’informatique.

compte-rendu

Prochainement.

création visuelle

Pour chaque rencontre du cycle, les commissaires invitent un.e artiste à créer une œuvre plastique en écho à la séance.

Lily Hook une artiste plasticienne genderqueer né.e au Canada et arrivé.e en France en 1999. Pendant ses études, ses recherches portent sur les représentations des corps, des genres et des sexualités en faisant dialoguer pornographie, cinéma et art contemporain. En parallèle, sa pratique plastique s'articule autour de l'inscription de la fiction sur les corps (présents ou absents), les objets et les reliques, la fluidité des genres et des sexualités, l'autofiction, les mythologies familiales et l'expérience de la diaspora. Toujours en dialogue, ses travaux et ses recherches se nourrissent de pensées décoloniales, de politiques queer et de spiritualité.

fiction

Pour chaque rencontre du cycle, les commissaires invitent un.e aut.rice.eur à écrire un texte en écho à cette séance.

Ketty Steward est poétesse et écrivaine de science-fiction. Ses dernières nouvelles se trouvent dans son recueil de science-fiction, Connexions Interrompues, chez Rivière Blanche, les anthologies Malpertuis V et L'Amicale des jeteurs de sorts, aux éditions Malpertuis, Faites demi-tour dès que possible et Au Bal des Actifs aux éditions La Volte, ainsi que dans plusieurs numéros de la revue Galaxies. Elle est également l'autrice d'un court roman autobiographique, Noir sur Blanc paru en 2012 aux éditions Henry.

Le Silence des Algos

« Solitude : douce absence de regards. » Milan Kundera, L’immortalité, fin du XXe siècle

J’ai passé deux jours de suite chez moi. Deux jours de congés. On n’est pas censés faire ça.

Ce n’est pas à proprement parler interdit, mais tout nous incite à sortir : la prime présentielle au travail, les sollicitations de nos réseaux pendant la demi-journée chômée, les spectacles live, les musées 4D, les soins d’entretien corporel…

Les cellules d’habitation sont les derniers lieux où l’on peut refuser la grille de contrôle. Bien sûr, on y perd. L’expérience utilisateur se trouve « moins personnalisée », comme ils disent.

Qui voudrait vivre une expérience lambda ? Qui veut encore choisir ses programmes de détente et ses habits manuellement ? Commander ses denrées alimentaires et ses médicaments chaque semaine ? Piloter sa domotique à la voix ? Gérer son calendrier ?

Certains moteurs libres sont safe, hors circuit commercial et tout aussi efficaces pour automatiser le quotidien. Rien d’illégal. Simplement, ceux qui s’en servent sont suspects. C’est le prix à payer pour l’illusion de l’autonomie.

Je n’ai jamais eu de problème. Pas jusque-là.

Au début, je n’ai rien remarqué. Le silence électronique, au bout de 2880 minutes, on s’y habitue.

Ce matin, je suis passée devant la boulangerie et un bip de couleur mauve m’a avertie de la promotion du jour. Deux brioches protéinées achetées, une offerte. De la publicité passive. Je déteste les brioches protéinées. C’est à ce moment-là que j’ai réalisé qu’aucun des panneaux croisés dans ma rue ne m’avait directement interpellée. Étrange.

J’ai marché, sans guidage satellite, jusqu’à la station de Moov, sans flashs info, sans voyants lumineux, sans aucun de ces signaux que j’interromps quelquefois quand je veux commencer la journée en douceur.

Lorsque j’ai pris place sur le tapis rapide, il m’a fallu confirmer ma destination. Je n’étais plus enregistrée sur les Services du réseau Moov ?

Plus tard, devant l’entrée de mon immeuble de bureaux, même chose ! J’ai dû saisir, sur une antique console, mon code confidentiel que j’ai eu un peu de mal à me rappeler.

J’ai emprunté le couloir où nous nous bousculons chaque matin par centaines pour nous rendre à nos postes de travail. J’ai croisé plusieurs collègues. J’en ai reconnu certains, à leur visage, mais aucune fiche ne s’activait sur ma rétine lorsque je me trouvais à leur hauteur. De leur côté, ils ne semblaient pas m’identifier.

J’ai pris l’élévateur sans encombre, mais je me sentais tout à fait nerveuse, en arrivant à mon étage.

« Juliette ! »

J’ai dû lui attraper la manche pour qu’elle me remarque. Ma voisine de bureau. Elle regardait dans le vague.

« Ah ! Salut, Tess ! ça va ? Tiens, tu as fait quelque chose à tes cheveux ? »

Rien. Elle ne comprenait pas que, pour la première fois, elle ne me voyait qu’au moyen de ses sens. Oui, j’ai toujours porté des tresses bleues.

J’ai allongé le pas, impatiente de me réfugier dans mon box. Au minimum, je pourrais me connecter pour tenter de découvrir ce qui clochait avec ma puce.

J’ai poussé la porte vitrée qui n’a pas bougé d’un millimètre. Heureusement, la biométrie fonctionnait encore. Vérification de la main droite. Voyant vert. Ouf !

Je suis entrée.

Ma playlist musicale ne s’est pas mise en route, mais je m’y attendais. Je me suis installée sur mon fauteuil qui a exigé : « Veuillez vous identifier.

— C’est moi !

— Empreinte vocale inconnue. Reconnaissance faciale enclenchée. Échec. Question. Seriez-vous non occidentale ?

— Ok-Wookie ! Identification par console.

— Console activée. Veuillez raccorder l’électrode à votre pouce gauche. Merci d’entrer votre mot de passe. »

Tout ce suspense me stressait. J’avais intérêt à suivre la procédure sans commettre la moindre erreur.

J’ai respiré.

On trouvait toujours un moyen de joindre les Services. Seulement, la fluidité des connexions à la volée m’avait fait oublier la quantité de données déversées quotidiennement dans les courants informationnels.

« Vous êtes maintenant connectée, Tessica Diébau. Voulez-vous procéder à une vérification de votre insert ?

— Oui. Diagnostic.

— Un instant. Phase un. Il apparaît que votre système d’exploitation n’est plus à jour. Les Services ne parviennent pas à vous localiser.

— Depuis quand ?

— Vous avez manqué l’update critique il y a quarante-neuf heures. Vous avez raté deux rappels d’update critique, il y a 33 heures, il y a 21 heures. Vous avez reçu un avertissement il y a 15 heures. Cela vous vaudra une pénalité de 218 crédits. Voulez-vous procéder à la mise à jour du système ? »

J’ai gardé le silence.

« Réponse requise. Voulez-vous procéder à la mise à jour critique ? »

Que se passerait-il si je décidais de rester à l’extérieur des flux ?

La tentation de disparaître m’a effleurée, je l’avoue. Être ailleurs. N’être nulle part. Échapper aux Services, à mes obligations. Échapper au pistage permanent. Pourquoi pas ?

Échapper au confort aussi. Échapper à la facilité. Échapper à la sécurité…

« Vous n’avez pas répondu. Voulez-vous… ?

— Oui. »

Cinq longues minutes de mise à jour ont suivi.

« Merci de garder le pouce branché pendant toute la durée de l’opération »

Une mise à jour… Pour améliorer quoi ?

« L’intégration des Services » ou encore « la performance de l’expérience-utilisateurs », m’a-t-on souvent affirmé.

Ça ne veut rien dire. C’est toujours la même réponse. Inutile de chercher à comprendre.

Mais voilà, je me pose des questions.

Ce n’est pas clairement interdit. C’est fortement déconseillé.

Je ne sais pas ce que je déciderai lors de la prochaine mise à jour critique.

« Voulez-vous autoriser la mise à jour automatique ?

— Non.

— Vous risquez de passer à côté d’améliorations importantes. Veuillez confirmer cette option.

— Je confirme. »

J’aimerais avoir encore le choix. Un peu.

On n’oublie pas si facilement le goût du silence.

Fin